Curso de SPSS básico

Índice del Artículo

Vista de Variables

En primer lugar, desde la ‘Vista de variables’ se definen las variables del estudio, sus tipos, etiquetas, valores y escala (las continuas numéricas se definen como escala, las categóricas como nominales y las jerárquicas, en las que importa el orden, como ordinales). Los valores missing (perdidos), se suelen codificar con el valor 99.

Ordenar Casos con SPSS

Como si de una hoja de cálculo se tratara, se pueden ordenar los registros en función de una variable de interés de manera ascendente o descendente (numérica o alfabética).

Recodificar en distintas variables

En la barra de menú del paqute estadístico SPSS: Transformar‘ + ‘Recodificar en distintas variables‘, se puede convertir una variable continua en una variable de rango ordinal tipo Likert, para que pueda formar grupos independientes para contraste de medias de 2 grupos con una T de Student, supuesta normalidad y homogeneidad de varianzas (en el caso de no cumplise los supuestos, proceder con la U de Mann-Whitney); una tabla ANOVA y las pruebas POST-HOC, si hay diferencias estadísticamente significativas entre algún par de medias, (si la reconversión es en 3 o más grupos); o su equivalente no paramétrico, esto es, un contraste de medianas de la variable de respuesta, en los grupos que conforma la variable explicativa. con Kruskal-Wallis, siempre en el caso de no cumplirse las condiciones previas de ANOVA.

Tabla de Frecuencias

El recorrido intercuartílico es una medida de dispersión de los datos de la muestra, se calcula mediante la diferencia entre el tercer y el primer cuartil. El coeficiente de variación es el cociente entre la desviación típica y la media aritmética, se suele expresar en porcentaje (%), un valor inferior a 0,3 suele implicar que la media de nuestra distribución es representativa. Sirve principalmente para comparar las dispersiones de muestras, medidas en las mismas unidades o en diferentes (se puede comparar por ejemplo la dispersión del peso y de la altura, cual de los 2 es más homogéneo).

Un coeficiente de asimetría positivo (mayor que 0), nos indica que la distribución de los datos de la muestra es asimétrica a la derecha o positiva. La curtosis nos habla de como de apuntada o aplastada es la representación de los valores de la variable.

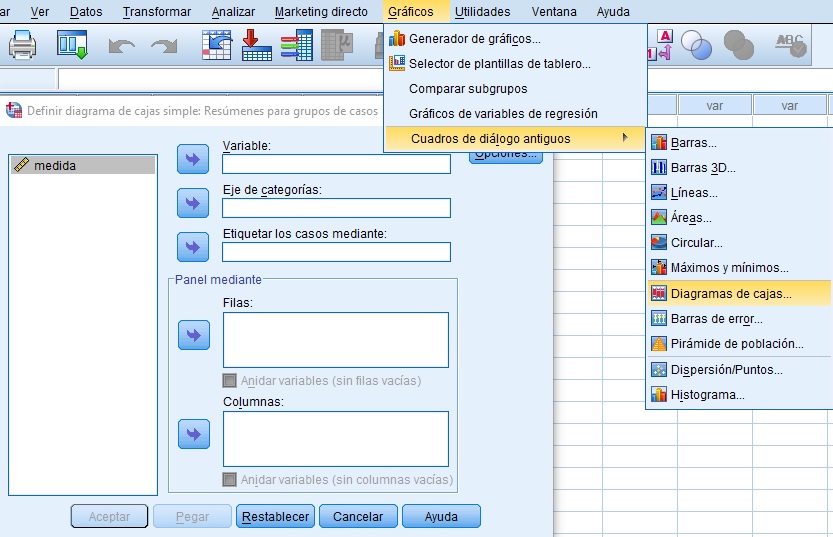

Diagrama de cajas y bigotes o Box-Plot

Sirve para comparar medianas, a partir del rango intercuartílico, y sobre todo para detectar outliers (puntos raros) y valores extremos, para de esta manera poder depurar nuestra base de datos, paso previo a cualquier tipo de análisis estadístico.

Intervalo de Confianza para la media poblacional al 95%

En la barra de menú ‘Analizar‘ + ‘Estadísticos Descriptivos‘ + ‘Explorar‘. Estimar el parámetro poblacional media, proporcionando un límite inferior y uno superior para la estimación, con un nivel de confianza para la inferencia del 95%.

Test de Normalidad

En función de que el tamaño muestral sea mayor de 50 (K-S-L), o menor de 50 (Shapiro-Wilk) se contrasta la hipótesis nula de que los datos se distribuyen como una Normal, siendo estadísticamente significativo el que el p-valor correspondiente sea menor que 0,05, en cuyo caso se rechaza la Normalidad de la distribución de la muestra de la variable de respuesta dependiente continua en estudio, y no se puede proceder desde un punto de vista paramétrico.

Representación gráfica de la Dispersión de 2 variables

Cómo realizar la representación gráfica de la nube de puntos del cruce de 2 variables numéricas-continuas (escala) en SPSS, a partir de que pueda existir correlación lineal entre ellas, y medida de bondad del ajuste en el ángulo superior derecha, con el coeficiente de determinación (valores entre 0 y 1, cuanto más proximo a 1, mejor ajuste lineal).

Recta de regresión lineal entre 2 variables tipo escala en icono de barra de herramientas de gráficos: ‘Añadir línea de ajuste total’.

estamatica@gmail.com